Matematyka sztucznej inteligencji – co kryje się za sieciami neuronowymi

Matematyka sztucznej inteligencji – co kryje się za sieciami neuronowymi

W dobie cyfrowej rewolucji sztuczna inteligencja (AI) jest nieodzownym elementem wielu dziedzin, od medycyny po finanse. Kluczowym komponentem AI są sieci neuronowe – inspirowane działaniem ludzkiego mózgu algorytmy komputerowe, które umożliwiają maszynom uczenie się i rozwiązywanie złożonych problemów. Ale co tak naprawdę stoi za ich działaniem? W tym artykule przyjrzymy się matematyce sieci neuronowych, ich budowie, podstawowym pojęciom oraz praktycznym zastosowaniom.

Co to są sieci neuronowe?

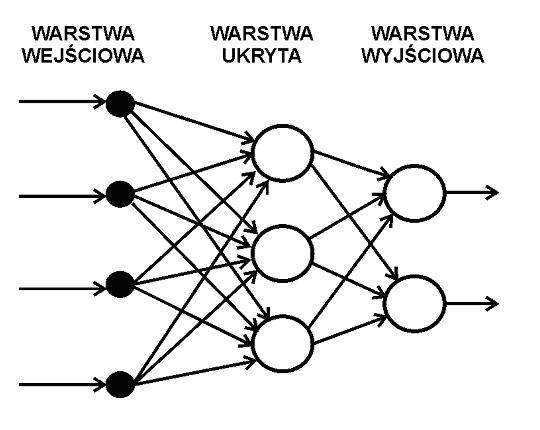

Sieci neuronowe to struktury matematyczne, które próbują naśladować sposób funkcjonowania neuronów mózgowych. Składają się z warstw neuronów (węzłów), pomiędzy którymi zachodzą skomplikowane zależności i przepływ informacji. Każdy neuron działa na podstawie wartości wejściowych, które są sumowane i przetwarzane za pomocą specjalnej funkcji aktywacji.

Podstawowe komponenty sieci neuronowej:

- Neurony (węzły) – podstawowe jednostki przetwarzania danych.

- Wagi – parametry określające siłę połączeń między neuronami.

- Bias (próg) – stała dodawana do sumy wejść, przesuwająca funkcję aktywacji.

- Funkcje aktywacji – nieliniowe funkcje decydujące o wyjściu neuronu.

Matematyczne podstawy sieci neuronowych

Matematyka stanowi fundament wszystkich mechanizmów, które stoją za uczeniem maszynowym i sieciami neuronowymi. Oto najważniejsze elementy matematyczne:

1. Wejścia i wagi – wektorowa reprezentacja danych

Każdy neuron otrzymuje sygnały w postaci liczbowej (wektor x), które następnie są mnożone przez odpowiednie parametry – wagi (w). Matematycznie oznacza to iloczyn skalarny:

z = w_1 x_1 + w_2 x_2 + … + w_n x_n + b,

gdzie b to bias. Wektorowe operacje pozwalają na efektywne przetwarzanie bardzo dużych zbiorów danych.

2. Funkcje aktywacji – nieliniowość w modelach

Funkcje aktywacji przekształcają wyniki sumowania wejść, nadając modelowi zdolność do rozwiązywania nieliniowych problemów. Najpopularniejsze to:

- ReLU (Rectified Linear Unit): ( max(0, z) ) – szybka i efektywna.

- Sigmoid: ( frac{1}{1 + e^{-z}} ) – generuje wyniki od 0 do 1, używana w klasyfikacji binarnej.

- Tanh: ( tanh(z) ) – wartości pomiędzy -1 a 1.

3. Propagacja sygnału i funkcja kosztu

W procesie forward propagation sygnały przechodzą przez kolejne warstwy, generując wynik sieci. Na jego podstawie obliczana jest funkcja kosztu (np. błąd średniokwadratowy), która pozwala ocenić jakość predykcji.

4. Optymalizacja i uczenie – metoda gradientów

Najważniejszą matematyczną techniką podczas uczenia sieci jest backpropagation, czyli obliczanie gradientów funkcji kosztu względem wag i biasów. Następnie algorytmy optymalizacji (np. Stochastic Gradient Descent) aktualizują parametry, minimalizując błąd modelu.

| Termin | Opis | Rola w sieciach neuronowych |

|---|---|---|

| Wagi (Weights) | Parametry modelu uczone na podstawie danych | Regulują siłę połączeń między neuronami |

| Bias | Stała dodawana do sumy wejść neuronu | Przesuwa funkcję aktywacji, wpływając na wyjście neuronu |

| Funkcja aktywacji | Nieliniowa przekształcenie wartości sumy ważonej | Dodaje nieliniowość do modelu, umożliwiając rozwiązywanie skomplikowanych zadań |

| Gradient | Wskaźnik zmiany funkcji kosztu względem parametrów | Podstawa procesu uczenia i optymalizacji modelu |

Dlaczego matematyka jest kluczem do lepszego zrozumienia AI?

Zrozumienie matematycznych podstaw sieci neuronowych pomaga:

- lepiej projektować algorytmy uczenia maszynowego,

- dobierać odpowiednie parametry i architektury sieci,

- diagnozować i poprawiać działanie modeli AI,

- tworzyć innowacyjne rozwiązania dopasowane do różnych zastosowań,

- doceniać ograniczenia i wyzwania związane z działaniem AI.

Praktyczne zastosowania sieci neuronowych

Sieci neuronowe znajdują szerokie zastosowanie w codziennym życiu i biznesie, w tym:

- Rozpoznawanie obrazów i dźwięków – od systemów rozpoznawania twarzy po tłumaczenia mowy na tekst.

- Diagnostyka medyczna – analiza obrazów medycznych i wspomaganie decyzji lekarzy.

- Finanse – prognozowanie rynków, wykrywanie oszustw finansowych.

- Robotyka i autonomiczne systemy – sterowanie pojazdami bezzałogowymi i robotami przemysłowymi.

- Natural Language Processing (NLP) – chatboty, tłumaczenia maszynowe, analiza sentymentu.

Podsumowanie – co warto zapamiętać?

Matematyka sztucznej inteligencji, a zwłaszcza sieci neuronowe, opiera się na skomplikowanych, ale eleganckich modelach matematycznych. Ich siłą jest zdolność uczenia się i adaptacji dzięki nieliniowości, optymalizacji i wielowymiarowym operacjom. Poznając podstawową matematykę AI, można lepiej wykorzystać tę technologię, tworzyć bardziej efektywne modele i rozumieć, dlaczego sieci neuronowe zdobią obecnie czołówkę najważniejszych narzędzi cyfrowej transformacji.

Zachęcamy do dalszego zgłębiania tematu, ponieważ przyszłość AI, której fundamentem jest matematyka, ma przed nami ogromne możliwości.

Więcej na temat sztucznej inteligencji, jej działania i praktycznych zastosowań znajdziesz również na Emerald Media oraz Techsetter.